Houve uma semana, no início do ciclo da bolha da internet, em que os números das empresas de tecnologia pararam de ser sobre o presente e começaram a ser sobre o que o mundo ainda ia se tornar. Quem olhava para os balanços de 1999 pela métrica certa — não o lucro trimestral, mas o quanto da infraestrutura futura estava sendo paga antecipadamente — saía com uma leitura completamente diferente da narrativa dominante. Esta semana foi, à sua maneira, (mais) uma dessas semanas.

Dois resultados trimestrais importantes ocuparam o centro do tablado. E o que eles revelam, lidos em conjunto, é mais interessante do que qualquer um deles isoladamente.

Nvidia: quando um número deixa de surpreender e começa a ser esperado

A Nvidia reportou receita recorde de US$ 68,1 bilhões no quarto trimestre do seu ano fiscal 2026 — alta de 73% sobre o mesmo período do ano anterior e de 20% em relação ao trimestre imediatamente anterior. Para o ano inteiro, a receita atingiu US$ 215,9 bilhões, alta de 65% sobre 2025. Os números bateram as estimativas com folga, e o guidance para o trimestre seguinte — US$ 78 bilhões, mais ou menos 2% — veio acima do que o mercado antecipava.

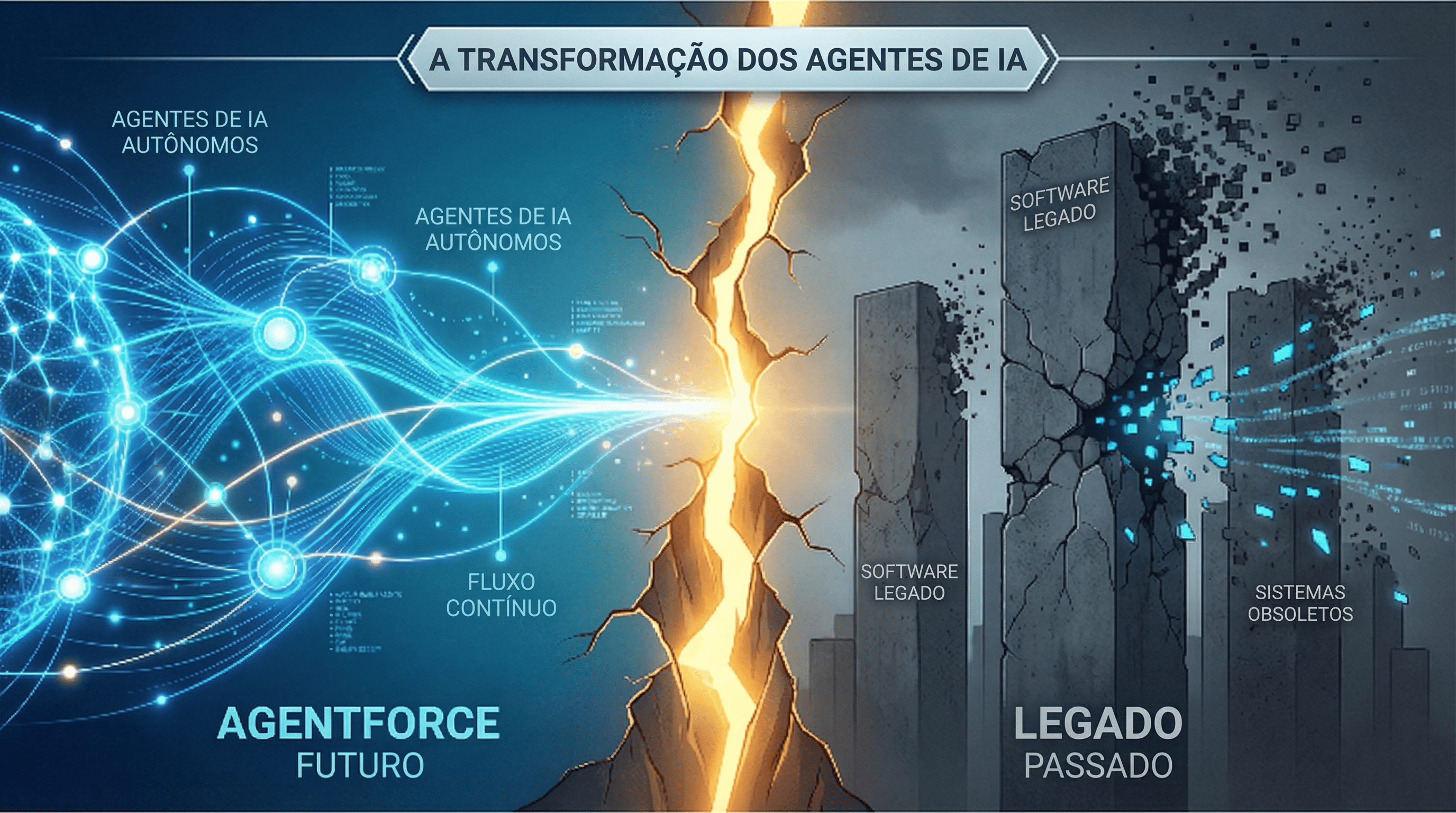

A empresa agora retira mais de 91% de suas receitas do segmento de data centers, onde os chips de IA dominam o portfólio. A frase que Jensen Huang usou no conference call é reveladora da virada narrativa em curso: "The agentic AI inflection point has arrived". Não "está chegando". Não "se aproxima". Ele chegou.

O paradoxo da Nvidia é que seus números deixaram de ser surpreendentes da forma que costumavam ser. Não porque deixaram de ser relevantes — mas porque o mercado aprendeu a calibrar a ordem de grandeza. Quando uma empresa reporta crescimento de 73% num trimestre sobre uma base já enorme, o que muda é a pergunta. Ela deixa de ser o "quanto cresceu?" e passa a ser "por quanto tempo ela consegue sustentar isso?" — e, mais importante, "quem está construindo o que vai competir com ela?"

A resposta honesta, por ora, é que ninguém está tão perto quanto o mercado imagina. Os próprios hyperscalers — Alphabet, Amazon, Meta e Microsoft — respondem por mais de 50% da receita de datacenters da Nvidia. Eles são simultaneamente os maiores clientes e os que mais investem em chips proprietários para reduzir essa dependência. É uma tensão estrutural que vai demorar anos para se resolver e, enquanto isso, a Nvidia continua com o único endereço confiável para quem precisa de poder computacional agora.

Salesforce: o espelho incômodo do SaaS

Se a Nvidia é a confirmação da tese, a Salesforce é o teste dela. E o teste é mais interessante porque o resultado é mais ambíguo.

A empresa reportou o melhor trimestre absoluto da sua história. Receita de US$ 11,2 bilhões, crescimento de 12% — o mais rápido em dois anos — e EPS ajustado de US$ 3,81, superando o consenso em 25%. Pelo lado dos contratos futuros de entrega, a alta de 16% surpreendeu. São números que, em qualquer outro momento, produziriam celebração. Mas, ao invés disso as ações caíram.

O motivo não está escondido: o crescimento orgânico, retirada a contribuição da aquisição da Informatica, permanece em torno de 8%. Flat em relação aos últimos quatro trimestres. Sem sinal de aceleração. E o guidance para o ano fiscal 2027 — US$ 45,8 a 46,2 bilhões — ficou marginalmente abaixo do consenso de US$ 46,06 bilhões, com um crescimento orgânico implícito de apenas 7-8%.

O Agentforce, a grande aposta da empresa no mundo dos agentes autônomos, chegou a US$ 800 milhões de ARR — alta de 169% ano a ano. A Salesforce fechou mais de 29.000 contratos e processou 2,4 bilhões de "Agentic Work Units" — uma métrica nova criada para diferenciar o trabalho executado por agentes do simples consumo de tokens. Marc Benioff, CEO da companhia, apresentou casos concretos: a Wyndham Hotels com 5.000 implementações em 8.300 hotéis, a SaaStr reduzindo uma equipe de 15 pessoas para 2,5 humanos e 20 agentes.

Mas a pergunta que os analistas fizeram com insistência no conference call permanece sem resposta satisfatória: se o Agentforce está crescendo tão rápido, por que o portfólio mais amplo não acelera junto? Marketing & Commerce caiu pela primeira vez na história da empresa. Tableau e MuleSoft desaceleraram de forma acentuada. Cerca de 30% da receita de subscrição está em deterioração.

Esse é o dilema que a Salesforce personifica neste momento do mercado. É possível que o Agentforce seja genuinamente transformador — e que o restante do portfólio esteja num processo de transição inevitável para um modelo de precificação diferente, baseado em tarefas completadas e não em licenças por assento. Também é possível que o Agentforce seja um sucesso real mas periférico, que não consegue compensar a erosão estrutural dos produtos legados num mundo onde a IA começa a substituir as próprias ferramentas que a Salesforce vende.

Os próximos dois trimestres vão dizer. Mas há uma leitura mais estrutural que esses resultados sinalizam, e ela vai muito além do ticker CRM.

O Y Combinator, os agentes e a inversão da lógica de mercado

Enquanto o mercado digeria esses números, um podcast provocativo sobre o futuro do software circulava pelos grupos de founders e investidores: uma análise baseada nos insights mais recentes do Y Combinator sobre a ascensão da economia dos agentes de IA.

A tese central pode ser resumida numa frase: o cliente primário do software está mudando de humano para máquina.

Essa é uma inversão com consequências imensas, e que explica parte do que está acontecendo com a Salesforce — e com dezenas de outras empresas de software que ainda constroem produtos para pessoas que clicam em botões.

Agentes autônomos não navegam interfaces gráficas. Não leem marketing. Não recomendam ferramentas para os colegas no Slack. Eles consomem APIs, avaliam documentação com critérios de facilidade de adaptação, e trocam de ferramenta em milissegundos se a alternativa oferece menos fricção. O Y Combinator chama isso de "a psicologia do consumidor artificial": ignora o hype, busca estrutura, segue o caminho de menor resistência.

O caso mais ilustrativo que circula nesse debate é simples: um agente responsável por transcrever vídeos escolheu consistentemente o Whisper V1 — um modelo mais lento e mais caro — sobre o Groq, que era 200 vezes mais rápido e 10 vezes mais barato. Razão: a documentação do Whisper V1 era mais fácil de ler. Produto tecnicamente inferior venceu porque a documentação era melhor. Para quem constrói software, essa história muda tudo sobre onde alocar o esforço.

A lição mais ampla é que o go-to-market tradicional — brand building, UI sofisticada, suporte humano, geração de demanda via conteúdo — é crescentemente irrelevante para capturar o cliente que mais cresce em volume: o agente. O que importa agora é: sua API está bem documentada? Seus endpoints são acessíveis sem login? Sua arquitetura é legível por máquina? A empresa que vencer o próximo ciclo de software enterprise não vai ser necessariamente a que construiu a melhor interface. Vai ser a que construiu a documentação mais "palatável" para o modelo de linguagem que está escolhendo ferramentas em nome do seu cliente humano.

Há um conceito em desenvolvimento que o Y Combinator chama de "swarm intelligence" (algo como enxame de inteligência) em contraposição à busca por uma inteligência central, monolítica e onipotente. Em vez de um modelo único que faz tudo, o futuro que está emergindo é de enxames de agentes menores, mais baratos, especializados, colaborando em paralelo. É a estrutura que replica sistemas biológicos complexos: nenhum neurônio sozinho pensa, mas o conjunto produz cognição. Aplicado ao software empresarial, isso muda a arquitetura de como os produtos precisam ser construídos — e quem são os compradores que determinam quais sobrevivem.

O fio que conecta tudo

Nvidia, Salesforce e o manifesto do Y Combinator falam sobre o mesmo fenômeno a partir de ângulos diferentes.

A Nvidia vende as GPUs que processam os agentes. A Salesforce está tentando, com sucesso parcial, se tornar a plataforma onde esses agentes operam dentro das empresas. E o Y Combinator está dando cor, em tempo real, o conjunto de princípios que vai determinar quais empresas de software sobrevivem à transição.

O que conecta os três é a chegada do ponto de inflexão que Jensen Huang mencionou na call. O consumo de computação deixou de ser episódico — iniciado por um humano que digita e espera — e está se tornando contínuo, assíncrono e exponencialmente mais denso. Um agente autônomo operando dentro de uma empresa pode gerar em um dia o equivalente em requisições computacionais de centenas de usuários humanos. Multiplique isso por bilhões de agentes, e a demanda por infraestrutura que estava sendo projetada de forma agressiva para os próximos anos começa a parecer conservadora.

Para o investidor que acompanha a Capital Pulse, o mapa estrutural permanece o mesmo: a infraestrutura física — chips, servidores, energia, redes — continua sendo o ativo mais defensável do ciclo. Mas os resultados desta semana adicionam uma camada de complexidade: nem toda empresa que fala de IA está capturando o valor da transição. A diferença entre a Nvidia e a Salesforce desta semana é exatamente essa — uma está no centro da cadeia de valor da nova computação, a outra ainda está tentando descobrir como transformar o acesso a essa computação em crescimento orgânico real.

A pergunta que fica é simples: em que posição da cadeia você está — e o quanto dessa posição depende de um cliente humano que clica num botão?

Um parêntese necessário sobre o humor do mercado

Antes de fechar, vale um parêntese sobre as oscilações destes últimos dias — porque elas merecem ser lidas com o devido distanciamento.

Fevereiro foi um mês instável para as ações norte-americanas, com os principais índices oscilando bruscamente entre ganhos e perdas. O S&P 500 saiu do pico histórico de 7.002 pontos no final de janeiro para operar perto dos 6.800 nesta semana. O Nasdaq acumula perdas desde o topo. Há preocupações crescentes com novas restrições de exportação de chips para a China. A Groenlândia voltou ao vocabulário geopolítico. As tarifas de Trump voltaram a pressionar o humor dos traders.

Tudo isso é real. E nada disso altera o que foi descrito nas páginas anteriores.

Há uma distinção que o investidor de longo prazo precisa ter sempre calibrada: o ruído de posicionamento — aquele mal-estar que emerge quando agentes de mercado reagem a incertezas de curto prazo sem que o cenário estrutural tenha mudado — e a revisão de tese, que ocorre quando uma premissa fundamental precisa ser abandonada. O que vivemos em fevereiro é claramente o primeiro. Nenhuma das variáveis que sustentam o ciclo de infraestrutura de IA foi abalada: os balanços confirmaram a demanda, os guidances confirmaram a aceleração, e os próprios CEOs soaram mais confiantes do que em qualquer trimestre anterior.

O que muda em momentos assim não é o destino — é o preço do bilhete. E para quem consegue enxergar além do prazo de vencimento do próximo contrato futuro, oscilações construídas sobre inércia geopolítica e ansiedade macro têm um nome mais preciso: janela.

Forte abraço,

João Piccioni

Capital Pulse é publicada semanalmente com o objetivo de elevar a maturidade do investidor brasileiro e conectar o país ao que há de mais avançado no mundo.